وحدة "القرصنة الأخلاقية" بتاليس تبتكر نموذجًا لكشف تزييف الصور المنشأة بالذكاء الاصطناعى

• باعتبارها جزءاً من التحدي الذي وضعته وكالة ابتكار الدفاع الفرنسية (AID) للكشف عن الصور التي تم إنشاؤها بواسطة منصات الذكاء الاصطناعي اليوم، طورت الفرق في cortAIx، مسرع الذكاء الاصطناعي في تاليس، نموذج "ميتا" قادر على اكتشاف الصور المزيفة التي تم إنشاؤها بواسطة الذكاء الاصطناعي.

• أُنشئ نموذج "ميتا" في تاليس بناءً على مجموعة من النماذج، حيث يقوم كل منها بتعيين درجة أصالة للصورة لتحديد ما إذا كانت حقيقية أم مزيفة.

• يتم استخدام محتوى الصور والفيديو والصوت المولدة بواسطة الذكاء الاصطناعي والمستخدمة بشكل متزايد لأغراض التضليل والتلاعب والاحتيال على الهوية.

يعد الذكاء الاصطناعي الموضوع الرئيسي للأسبوع السيبراني الأوروبي هذا العام والمنعقد من 19 إلى 21 نوفمبر في رين، بريتاني. وفي تحدٍ نظمته وكالة ابتكار الدفاع الفرنسية (AID) تزامناً مع الحدث، نجحت فرق تاليس في تطوير نموذج "ميتا" للكشف عن الصور المولدة بواسطة الذكاء الاصطناعي. مع اكتساب استخدام تقنيات الذكاء الاصطناعي زخماً، وفي وقت أصبحت فيه المعلومات المضللة منتشرة بشكل متزايد في وسائل الإعلام وتؤثر على كل قطاع من قطاعات الاقتصاد، يعد نموذج "ميتا" للكشف عن التزييف العميق طريقة لمكافحة التلاعب بالصور في مجموعة كبيرة من حالات الاستخدام، مثل مكافحة انتحال الهوية.

يتم إنشاء الصور التي تم إنشاؤها بواسطة الذكاء الاصطناعي باستخدام منصات الذكاء الاصطناعي مثل Midjourney وDall-E وFirefly. وتوقعت بعض الدراسات أنه في غضون بضع سنوات، قد يتسبب استخدام التزييف العميق لسرقة الهوية والاحتيال في خسائر مالية ضخمة. وقد قدرت شركة غارتنر أن حوالي 20٪ من الهجمات الإلكترونية في عام 2023 من المحتمل أن تتضمن محتوى مزيفاً عميقاً كجزء من حملات التضليل والتلاعب. ويسلط تقريرهم الضوء على الاستخدام المتزايد للتزييف العميق في الاحتيال المالي وهجمات التصيد المتقدمة.

يقول كريستوف ماير، الخبير الأول في الذكاء الاصطناعي والمسؤول التقني لنظام cortAIx، مسرع الذكاء الاصطناعي لشركة تاليس، إن "نموذج ميتا للكشف عن التزييف العميق من تاليس يعالج مشكلة انتحال الهوية وتقنيات التزييف". و"إن تجميع طرق متعددة باستخدام الشبكات العصبية واكتشاف الضوضاء وتحليل التردد المكاني يساعد على حماية العدد المتزايد من الحلول التي تتطلب عمليات فحص الهوية البيومترية بشكل أفضل. وهذا تقدم تكنولوجي ملحوظ وشهادة على خبرة باحثي الذكاء الاصطناعي في تاليس".

يستخدم نموذج "ميتا" من تاليس تقنيات التعلم الآلي ومخططات تسلسل القرار وتقييم نقاط القوة والضعف لكل نموذج لتحليل صحة الصورة. فهو يجمع بين نماذج مختلفة، بما في ذلك:

2 / 3

• تتضمن طريقة CLIP (التدريب المسبق للغة والصورة التباينية) ربط الصورة والنص من خلال تعلم التصورات الشائعة. للكشف عن التزييف العميق، تحلل طريقة CLIP الصور وتقارنها بأوصافها النصية لتحديد التناقضات والمشكلات البصرية.

• تستخدم طريقة DNF (ميزة الضوضاء الانتشار) هياكل توليد الصور الحالية (تسمى نماذج الانتشار) للكشف عن التزييف العميق. تعتمد نماذج الانتشار على تقدير كمية الضوضاء التي يجب إضافتها إلى الصورة للتسبب في "الهلوسة"، والتي تخلق محتوى من لا شيء، ويمكن استخدام هذا التقدير بدوره للكشف عما إذا كانت الصورة قد تم إنشاؤها بواسطة الذكاء الاصطناعي.

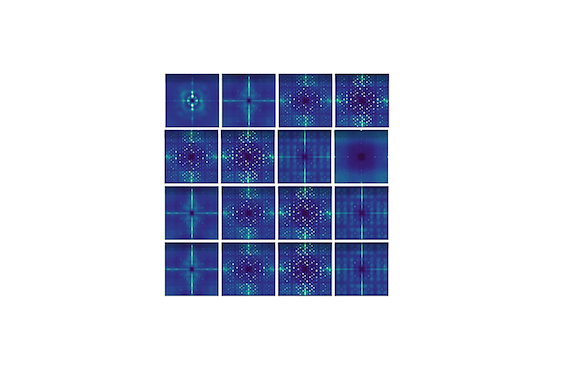

• إن طريقة DCT (تحويل التجيب المتقطع) للكشف عن التزييف العميق تحلل الترددات المكانية للصورة لاكتشاف المشكلات المخفية. من خلال تحويل صورة من المجال المكاني (البكسل) إلى مجال التردد، يمكن لـ DCT اكتشاف الشذوذ الدقيق في بنية الصورة، والذي يحدث عند إنشاء التزييف العميق وغالباً ما يكون غير مرئي للعين المجردة.

يعد فريق تاليس الحقيقي لهذا الاختراع جزءاً من نظام cortAIx مسرع الذكاء الاصطناعي التابع للمجموعة، والذي يضم أكثر من 600 باحث ومهندس في مجال الذكاء الاصطناعي، 150 منهم يعملون في مجموعة أبحاث وتكنولوجيا في بلدية ساكلاي في جنوب باريس، ويعملون على أنظمة بالغة الأهمية. وقد طور فريق "القرصنة الأخلاقية" مجموعة أدوات تسمى BattleBox للمساعدة في تقييم قوة الأنظمة التي تعمل بالذكاء الاصطناعي ضد الهجمات المصممة لاستغلال نقاط الضعف الجوهرية في نماذج الذكاء الاصطناعي المختلفة (بما في ذلك نماذج اللغة الكبيرة)، مثل الهجمات المعادية ومحاولات استخراج المعلومات الحساسة. لمواجهة هذه الهجمات، يطور الفريق تدابير مضادة متقدمة مثل إلغاء التعلم، والتعلم الموحد، ووضع علامات مائية على النماذج، وتقوية النماذج.